- ZAM apila nueve capas de memoria funcional verticalmente dentro de cada módulo compacto

- Cada capa de memoria ZAM tiene exactamente 1.125GB de capacidad DRAM

- Las cifras estimadas de ancho de banda de ZAM ahora están cerca del territorio de rendimiento de Nvidia HBM4

La arquitectura de la memoria de las computadoras experimentará una transformación estructural significativa en los próximos años.

Un nuevo diseño llamado memoria de ángulo cero (ZAM) apila los chips verticalmente en lugar de extenderlos sobre una superficie plana, una medida que puede acelerar la transferencia de datos y al mismo tiempo reducir el consumo de energía.

Intel ha apoyado esta tecnología como un posible reemplazo de la memoria HBM existente.

Dentro del diseño de memoria ZAM de nueve capas

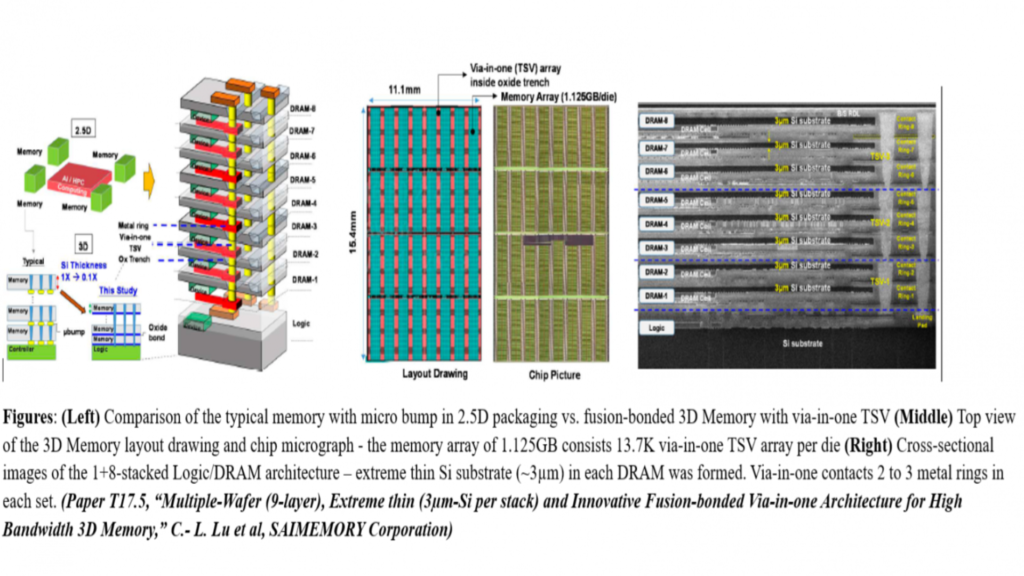

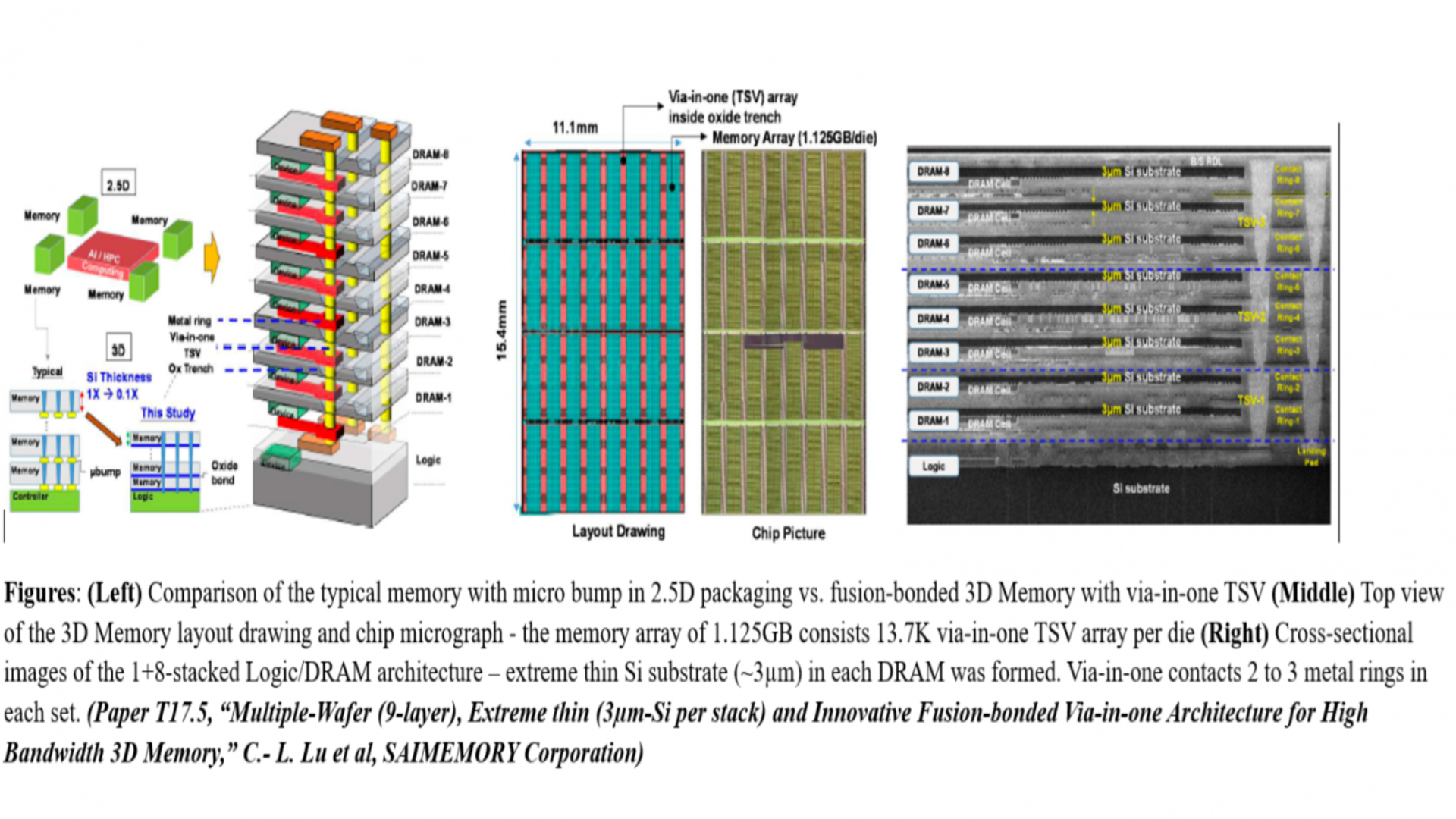

Los diagramas técnicos de un próximo documento de la conferencia VLSI ahora han revelado los detalles internos de este diseño de memoria.

Ocho capas de almacenamiento DRAM separadas se encuentran debajo de una única capa de control dentro de cada módulo ZAM construido por el consorcio.

Esta disposición proporciona a cada módulo un total de nueve capas funcionales apiladas verticalmente una encima de otra.

Las imágenes del documento de la conferencia muestran cómo cada una de las ocho capas de DRAM tiene una capacidad de almacenamiento de 1,125 GB.

Por lo tanto, las matemáticas básicas dan aproximadamente 9 GB de memoria total por módulo ZAM antes de cualquier deducción general.

Tres vías de silicio (TSV) recorren toda la pila vertical para conectar eléctricamente cada capa de arriba a abajo.

Intel ha desarrollado métodos de unión por fusión que realizan estas conexiones TSV con extrema precisión y confiabilidad.

Cada capa de DRAM está separada de su vecina por un sustrato de silicio de sólo 3 micrones de espesor.

Estos TSV conectan dos o tres anillos metálicos en cada capa para obtener una corriente eléctrica estable.

Las estimaciones de ancho de banda derivadas de afirmaciones anteriores sitúan ahora a ZAM más cerca de las cifras de rendimiento de HBM4 para la plataforma Vera Rubin de Nvidia.

ZAM apunta al ancho de banda de clase HBM4

Una empresa japonesa llamada Saimemory Corporation lideró el esfuerzo de comercialización de esta tecnología respaldada por Intel.

Saimemory funciona como una subsidiaria de propiedad total de SoftBank y aún no ha publicado las tarifas de datos oficiales para este nuevo diseño de memoria.

Declaraciones anteriores de la compañía sugirieron un aumento de velocidad de dos a tres veces con respecto al estándar de memoria HBM3 actual.

HBM3 actualmente ofrece 819 GBps (o 6,4 Gbps) de ancho de banda en su configuración estándar, por lo que triplicar esa línea base le daría a ZAM alrededor de 2,5 TBps de rendimiento total para procesadores de IA.

La plataforma Vera Rubin AI de Nvidia se basa en HBM4 para las configuraciones de ancho de banda más altas disponibles.

Esta paridad de rendimiento pone a la tecnología de memoria HBM-Killer de Intel en competencia directa con el estándar de memoria preferido de Nvidia.

Hasta el momento, todavía no se ha mostrado ningún prototipo funcional de ZAM a revisores independientes o laboratorios de terceros en ningún lugar del mundo.

La fabricación de ocho capas unidas sin introducir defectos sigue siendo un desafío industrial difícil y no probado para este consorcio.

HBM4 se beneficia de la hoja de ruta de producción ya establecida de Nvidia y de la cadena de suministro global existente entre múltiples proveedores.

Un estándar de memoria con características técnicas superiores a menudo falla sin una adopción amplia del ecosistema y el apoyo de la industria a lo largo del tiempo.

Las presentaciones en la conferencia VLSI de junio determinarán si las afirmaciones de Intel sobre el asesino de HBM van más allá de los dibujos en papel hacia la realidad física.

A través de HPC WIRE

Siga TechRadar en Google News Y Agréganos como fuente preferida Recibe noticias, reseñas y opiniones de nuestros expertos en tu feed.