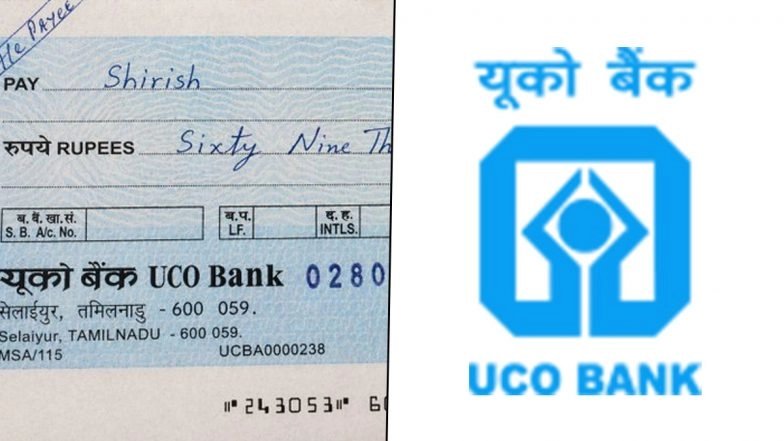

Une image réelle d’un chèque bancaire UCO créée par l’intelligence artificielle est devenue virale sur les réseaux sociaux, déclenchant un débat sur la fraude financière et les progrès rapides de la synthèse d’images par l’IA. La photo, partagée sur X (anciennement Twitter) par un utilisateur nommé Shirish, montre un chèque détaillé de 69 000 INR tiré à son nom. L’utilisateur a déclaré que les images avaient été créées à l’aide de « ChatGPT Images 2.0 », un outil récemment publié par OpenAI.

Le message, sous-titré « Nous sommes trop cuits », a rapidement gagné du terrain lorsque les utilisateurs ont remarqué la précision surprenante de la photo. Le chèque généré par l’IA comprenait des informations complexes telles que l’adresse de l’agence, la ligne de signature, le numéro de compte et même le groupe MICR en bas, ce qui rendait difficile de le distinguer d’un véritable document bancaire au premier coup d’œil.

Un utilisateur X partage une vraie fausse banque UCO créée avec des images ChatGPT 2.0

Faux chèque de la banque UCO (Crédit photo : X/X/@shiri_shh)

Les captures d’écran de ChatGPT 2.0 transmettent les techniques de sécurité de l’IA

L’incident a soulevé des questions sur la sécurité des modèles d’IA populaires. Lorsque certains utilisateurs lui ont demandé comment de faux chèques pouvaient être créés malgré les politiques strictes de la plateforme contre la création de documents frauduleux, Shirish a répondu qu’il existe des « astuces » utilisées pour contourner ces restrictions. Il a ajouté que même si ces méthodes ne fonctionnent pas toujours, elles réussissent parfois à créer une interdiction.

La quantité de détails dans le résultat a semé la confusion. Bien que certains utilisateurs aient apprécié « l’intelligence » de la nouvelle image, beaucoup craignaient que de tels dispositifs rendent impossible pour une personne moyenne de faire confiance aux preuves vues sur Internet, qu’il s’agisse d’une photo ou d’une vidéo.

Évaluation des risques et sécurité du système

Malgré leurs apparitions publiques, certains économistes ont sous-estimé la menace de corruption dans les banques. Les chercheurs ont montré que les méthodes modernes de compensation bancaire utilisent des couches d’authentification avancées qui vont au-delà de l’évidence, notamment des signatures numériques et des bases de données sécurisées qu’une image générée par l’IA ne peut pas reproduire.

“Ces contrefaçons semblent convaincantes aux yeux des gens, pas aux véritables machines qui déposent de l’argent”, a déclaré un utilisateur, soulignant que la détection traditionnelle des fraudes reste difficile. Cependant, d’autres ont fait valoir que le plus grand risque réside dans l’ingénierie sociale, l’utilisation de telles images pour inciter les gens à se livrer à des activités secrètes ou à des escroqueries en ligne sans vérification automatique.

Contexte : Développement de l’IA haute fidélité

Ce débat fait suite à la récente sortie de ChatGPT Graphics 2.0 par OpenAI. La société a également décrit le dernier modèle comme étant capable de gérer des « tâches visuelles complexes » et de créer une « intelligence » dans sa conception. Une vidéo récemment partagée par OpenAI a montré la capacité du modèle à créer des visuels de plus en plus difficiles à séparer de la réalité.

Alors que l’IA continue de brouiller la frontière entre réel et artificiel, certains utilisateurs de médias ont suggéré qu’un retour à la sécurité numérique, ou plus spécifiquement au papier, pourrait être nécessaire pour prévenir la fraude. L’analyse des virus rappelle la « course aux armements » en cours entre la création de produits d’IA et les outils numériques nécessaires à leur vérification.

(L’histoire ci-dessus a été publiée pour la première fois récemment le 23 avril 2026 à 17h20 IST. Pour plus d’informations et de mises à jour sur la politique, le monde, les sports, le divertissement et le style de vie, visitez notre site Web Latestly.com).