Las previsiones del sector suenan alarmantes. Mantenerse al día con las insaciables demandas computacionales de la IA requerirá cientos de miles de millones de dólares de inversión en nuevos centros de datos en los próximos años.

Bain & Company proyecta que este gasto anual alcanzará los 500 mil millones de dólares por año para 2030. Se están estableciendo proyectos como SoftBank, OpenAI y la iniciativa Stargate liderada por Oracle para satisfacer esta demanda.

El artículo continúa a continuación.

CEO y cofundador de Pathway.

Cuente más. Más capas. Más información. Este es el argumento que vemos y escuchamos hoy. Esto nos lleva a un camino sostenible, creando un desafío que no es una preocupación del mañana. Una crisis de poder de la IA es inevitable a corto plazo si nos atenemos al camino marcado por la sabiduría convencional de escalamiento ascendente.

Estar aferrado a esa trayectoria también ignora una dura verdad: los LLM de hoy tienen una demanda insostenible de economía unitaria y, más específicamente, de arquitectura de transformadores basada en capacitación y suposiciones.

El auge de los modelos de razonamiento, que crean más indicios en el texto de “pensamientos” ocultos antes de responder, exacerba el problema. Un estudio de 2025 encontró que, si bien un aviso largo en GPT-4o consume 0,42 Wh, un aviso largo para modelos lógicos puede consumir hasta 33,634 Wh (DeepSeek-R1) y 30,495 Wh (GPT-4.5). Esa es suficiente energía para cargar un teléfono inteligente, y algo más, según el mensaje.

El uso de tokens como única forma de mejorar los modelos y el coste computacional estimado crea un enorme interrogante sobre la viabilidad económica actual del mercado de herramientas de IA. Necesitamos un cambio de paradigma que sea dramáticamente correcto. Esa transición ya está en marcha y comienza dejando atrás el transformador. Bienvenidos a la era post-Transformers.

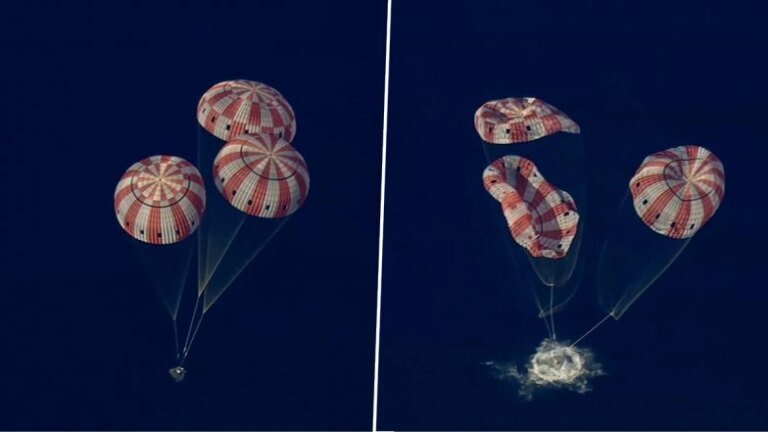

El resultado de la cadena de pensamiento lógico.

La mayor adopción de LLM por sí sola no explica la desbocada demanda de computación y energía de las empresas de inteligencia artificial. También es el resultado de que los LLM consuman más tokens con el tiempo.

La primera generación de LLM generó cientos de tokens por respuesta. En comparación, los modelos de ‘razonamiento’ actuales utilizan miles de tokens de pensamiento para mapear el razonamiento paso a paso hasta la cadena de pensamientos.

Pero la lógica surgió como una ocurrencia tardía en la arquitectura original que permaneció intacta desde el principio: el transformador. Los modelos basados en transformadores consumen muchísimos recursos.

Utilizan mucha computación porque procesan información que crece exponencialmente a medida que crecen los datos, requieren una memoria muy rápida para ejecutarse y ajustan y tienen en cuenta constantemente los parámetros de un modelo.

Naturalmente, seguir con los transformadores sin un esfuerzo significativo para introducir mecanismos para una lógica eficiente impulsó dramáticamente los requisitos de computación y energía de LLM. ¿Esa compensación resulta en un modelo más inteligente?

No hay un consenso creciente. Todas las señales apuntan a que los modelos actuales basados en transformadores alcanzarán un techo en términos de rendimiento, con rendimientos decrecientes a pesar de la creciente escala del modelo. El GPT-5, que se hundió en el lanzamiento a pesar de que tardó más de dos años en entrenarse, es el mejor ejemplo.

Los lanzamientos recientes de los principales laboratorios actuales han generado entusiasmo, pero ninguno ha producido los cambios arquitectónicos o cambios reales en la funcionalidad que requiere la industria. Más allá de la carrera por escalar, están cobrando fuerza alternativas reales.

Tomando señales de los sistemas biológicos

La respuesta está en el diseño más elegante de la naturaleza: el cerebro humano. El cerebro humano es un ejemplo brillante de un sistema natural que puede lograr hazañas cognitivas avanzadas con una eficiencia energética extraordinaria. Inspiradas por esto, nuevas y desafiantes empresas de IA están replicando cómo los humanos procesan la información en una nueva arquitectura para que los LLM cierren la brecha de habilidades y aprendizaje que separa a la IA actual de los modelos computacionales del cerebro.

El cerebro opera a través de 100 mil millones de neuronas que actúan como unidades computacionales, conectadas por cientos de billones de sinapsis que almacenan y transforman información. El número de conexiones sinápticas en cada neurona varía. Algunos actúan como ejes centrales con innumerables conexiones, y otros significativamente menos.

Esta dinámica se mantiene incluso cuando el cerebro crece y cambia, lo que lo convierte en una red óptima sin escala. Sorprendentemente, el cerebro utiliza sólo 20 vatios de potencia para alimentar esta red de neuronas. Esto equivale a la potencia de una bombilla de luz tenue y a una gota en el océano en comparación con las enormes demandas de energía de los principales LLM de hoy.

En 2025, introdujimos la arquitectura Dragon Hatching (BDH) para cerrar la brecha entre los modelos de IA y el cerebro mediante la replicación de la dinámica de las sinapsis neuronales en LLM. Mientras que los modelos basados en transformadores se basan en pesos fijos previamente entrenados (la misma base de conocimiento fija cada vez) para predecir los resultados, BDH funciona de manera diferente.

Solo se activan las neuronas artificiales relevantes para la tarea en cuestión y sus conexiones se fortalecen o debilitan según la experiencia adquirida en una implementación empresarial. Éste es el aprendizaje hebbiano en la práctica: “las neuronas que se activan juntas, se conectan juntas”, están dotadas de plasticidad sináptica al igual que nuestros propios cerebros. El resultado es un modelo que desarrolla inteligencia no sólo a través del entrenamiento, sino también a través del uso a través de interacciones locales.

Tiene una estructura similar a una red muy compacta y eficiente, que mantiene el conocimiento exactamente donde se procesa y permite el aprendizaje continuo sin los ciclos regulares de reentrenamiento en los que dependen los modelos basados en transformadores.

Este es un método alternativo muy necesario para mejorar la lógica LLM sin utilizar tokens. Las empresas pueden hacer más con LLM antes de exceder los límites de tokens porque no es necesario ejecutar modelos completos cada vez que se utilizan, solo las conexiones neuronales que son relevantes y necesarias para la tarea en cuestión.

Y las empresas de IA finalmente tienen una solución para mejorar las capacidades de razonamiento de los modelos y romper con el creciente consumo de energía de los transformadores que es insostenible. Es importante destacar que BDH es compatible con el hardware de uso general que hizo posible la pluma LLM.

La única manera de abordar las causas fundamentales es repensar la arquitectura.

Una crisis de energía de la IA es un escenario sombrío, pero no inevitable. Más bien, es un escenario basado en elecciones arquitectónicas que pueden deshacerse. Los transformadores cambiaron el mundo. En los últimos años, el modelo de capacidad de razonamiento agregado al LLM ha logrado mejorar el desempeño.

Pero la economía unitaria subyacente no es efectiva. La naturaleza ya proporciona soluciones al problema de la inteligencia adaptativa y eficiente, y el espíritu de la era post-Transformer reside en aprender las lecciones correctas de esto. Podemos construir sistemas de IA que se vuelvan más inteligentes con el uso, de una manera sostenible que no dependa de una ampliación infinita.

Para la iniciativa, esta no es sólo una historia ambiental: es económica. Buscamos reducir los costos estimados en 10 veces o más. La IA que razona eficientemente, aprende continuamente y requiere una fracción de la computación no es la aspiración futura. Esto es lo que ofrece hoy la arquitectura post-transformador.

Hemos presentado los mejores modelos de lenguaje a gran escala (LLM) para codificación.