Les utilisateurs de ChatGPT aux États-Unis ont été déconcertés par une récente augmentation des réponses d’IA mystérieusement écrites en arabe.

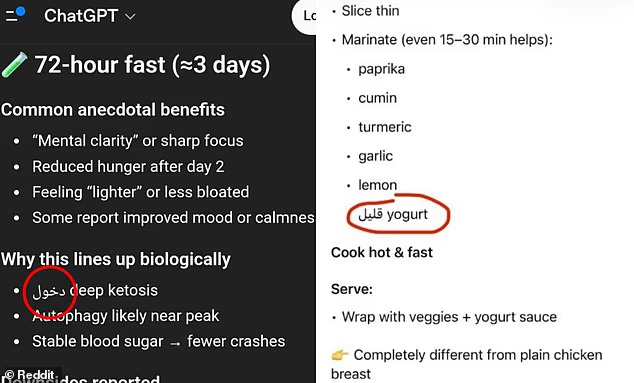

Le phénomène a pris de nombreux Américains anglophones au dépourvu au cours du mois dernier, nombre d’entre eux partageant des images de réponses générées par l’IA et ajoutant aléatoirement du texte arabe à leurs conversations sur les réseaux sociaux.

“Il l’a fait deux fois sur mon téléphone et une fois sur mon ordinateur portable de travail, je ne suis même pas dans un pays arabophone”, a écrit une personne sur Reddit, montrant comment le chatbot populaire a commencé à leur donner des ingrédients de recettes en arabe il y a deux semaines.

D’autres ont rapporté que les chiffres avaient également été modifiés en arabe et que l’IA avait même commencé à répondre aux requêtes en anglais en arménien, hébreu, espagnol, chinois et russe.

Alors que certains ont imputé ce texte bizarre aux hallucinations de l’intelligence artificielle, lorsque les chatbots donnent des réponses factuellement incorrectes ou complètement absurdes, il semble que le problème provienne en réalité de la façon dont ChatGPT est formé.

ChatGPT, également connu sous le nom de Large Language Model (LLM), ne lit pas les mots complets comme le font les humains, mais divise le texte en petits morceaux appelés « jetons », qui peuvent être des parties de mots, des signes de ponctuation ou même des mots courts provenant d’autres langues.

Étant donné que certains mots étrangers sont plus courts et plus faciles à traiter par le système, le modèle peut occasionnellement les sélectionner s’ils correspondent au contexte et nécessitent moins de jetons.

Cela ne signifie pas que l’IA change délibérément de langue, mais choisit simplement le prochain morceau de texte le plus probable en fonction de la probabilité.

Les utilisateurs de ChatGPT ont publié des images de réponses montrant comment des mots anglais simples étaient remplacés au hasard par des caractères de différentes langues.

ChatGPT d’OpenAI a de plus en plus répondu aux utilisateurs anglophones en arabe au cours du mois dernier (Image de stock)

ChatGPT, qui serait utilisé par près de 900 millions de personnes chaque mois, a été créé par la société d’intelligence artificielle OpenAI en 2022.

Il permet aux utilisateurs de saisir des questions ou des requêtes dans un langage normal et répond avec un texte étonnamment humain. Des millions de personnes l’ont utilisé pour rédiger des essais, expliquer des concepts, créer des histoires, traduire des langues, résoudre des problèmes ou simplement discuter.

Alors que d’autres chatbots IA ont suivi, notamment Google Gemini, kAI Grok et Anthropic Claude, GPT continue de dominer le marché, contrôlant près des deux tiers de ce secteur en pleine croissance.

OpenAI a publiquement abordé certains problèmes linguistiques, avec des problèmes similaires à des réponses étranges en arabe signalés dès 2024.

Il y a deux ans, les utilisateurs de GPT ont signalé des incidents généralisés de génération de « non-sens », causés par une erreur interne de mappage de jetons lors des mises à jour du modèle.

Cependant, aucune des annonces récentes de leur entreprise n’a abordé les erreurs de mélange de langues et les réponses inattendues en arabe aux requêtes en anglais.

Les utilisateurs des réseaux sociaux qui ont partagé ces mystérieuses réponses ont noté que les mots dans d’autres langues ne sont pas du charabia. Dans la plupart des cas, le mot avait en réalité la même signification que le mot anglais remplacé.

Un utilisateur de Reddit a répondu à une photo de la recette en expliquant : “Le mot signifie faible. Il semble donc qu’il manque un mot. Peut-être du yaourt faible en gras.”

Le problème est la façon dont ChatGPT est formé, en utilisant des milliards de mots de plusieurs langues (Stock Image)

ChatGPT a répondu à de nombreux utilisateurs qui ont vu des mots arabes aléatoires en disant que le texte avait été ajouté par erreur

Pour comprendre pourquoi ChatGPT enverrait des réponses en arabe à d’innombrables utilisateurs, il est utile d’examiner ce que sont réellement les « jetons ».

Les jetons utilisés par les chatbots IA peuvent inclure des mots entiers (tels que « bonjour »), des parties de mots (tels que « un- » ou « -ing »), des signes de ponctuation et des phrases plus courtes dans des langues étrangères.

Par exemple, le mot « compréhension » pourrait être compté comme trois jetons distincts dans une réponse de l’IA, se décomposant en « sous », « debout » et « ing ».

ChatGPT recherchera donc le moyen le plus efficace de répondre à une requête humaine, en utilisant le mot ou la phrase suivante la plus logique pour compléter sa réflexion en fonction de toutes les données avec lesquelles le chatbot a été formé.

Comme les utilisateurs l’ont récemment constaté, l’IA peut décider que le moyen le plus efficace de répondre à la question de quelqu’un est de taper un jeton au lieu de trois, même si l’alternative est un mot arabe que l’utilisateur ne comprend pas.

Cependant, certains ont soutenu sans preuve que les erreurs n’étaient pas accidentelles, affirmant que les versions précédentes de ChatGPT n’envoyaient jamais de réponses mélangées à des mots en langue étrangère.

“C’est la première fois qu’il fait cela, et j’utilise l’IA depuis des années. Cela ne peut pas être une erreur aléatoire”, a déclaré un utilisateur de GPT concerné.

Une autre personne sur les réseaux sociaux a posté que ChatGPT affirmait que le mot arabe était « entré » en répondant.

“Frère, je parle anglais. Pourquoi réponds-tu en arabe ?” Utilisateur GPT publié sur Ks.

“Il est entré par erreur.” GLISSÉ DEdans ??? C’est un alphabet complètement différent.